![图片[1]安全114-安全在线-安全壹壹肆-网络安全黄页-网络安全百科OpenAI 阻止了 20 个使用人工智能进行网络犯罪和虚假信息传播的全球恶意活动](https://www.anquan114.com/wp-content/uploads/2024/03/20240329190426586-image.png)

本周三,OpenAI方表示,自今年年初以来,它已经成功干扰了全球20多个,试图将其平台用于恶意运营和欺诈的网络活动。

它们主要采取了:调试恶意软件,为网站撰写文章,为社交媒体帐户生成传记,以及为X上的假帐户创建人工智能生成的个人资料图片的举措。

这家人工智能(AI)公司表示:“威胁者不断进化并持续使用我们的模型,但我们并未发觉其创建实质性新恶意软件或建立病毒受众的能力有真正意义上的突破。”

除此之外,OpenAI方还表示,它扰乱了在美国、卢旺达的选举以及较小程度上与印度和欧盟相关的社媒活动。这些网络都没有吸引到病毒式的参与或持续的受众。

这包括一家名为STOIC(也称为Zero Zeno)的以色列商业公司所做的努力,正如Meta和OpenAI今年5月初披露的那样,该公司在社交媒体上发表了关于印度选举的评论。

OpenAI强调的一些网络操作如下:

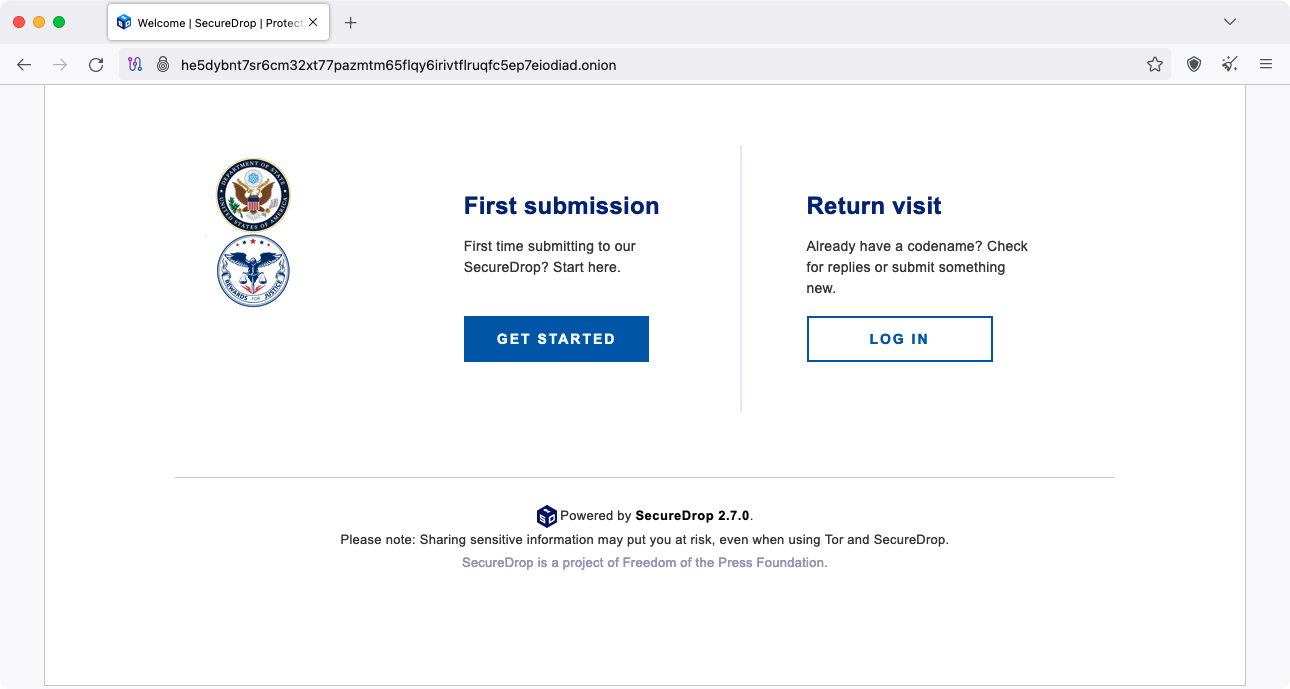

- SweetSpecter,疑似是以中国为基地的对手,利用OpenAI的服务进行LLM知情的侦察、漏洞研究、脚本支持、异常检测规避和开发。还观察到,它对OpenAI员工进行了失败的鱼叉式网络钓鱼的企图,以提供SugarGh0st RAT。

- Cyber Av3ngers是隶属于伊朗伊斯兰革命卫队(IRGC)的团体,使用其模型对可编程逻辑控制器进行研究。

- Storm-0817,来自伊朗的威胁者,使用其模型进行调试,能够收集包含敏感信息的Android恶意软件,通过Selenium抓取Instagram个人资料,并将LinkedIn个人资料翻译成波斯语。

该公司表示,在其他领域,它也采取了各种措施来阻止多个集群,包括代号为A2Z和Stop News的操作。这些帐户生成了英语和法语内容,以便日后在各类网站和社交媒体帐户上发布。

研究人员Ben Nimmo和Michael Flossman说:“[Stop News]在图像使用方面异常丰富。其许多网络文章和推文都附有DALL·E生成的图像。这些图像通常是卡通风格,以明亮的调色板或戏剧性的色调来吸引注意力。”

经OpenAI Bet Bot和Corrupt Comment识别发现,其网络使用API在X上与用户生成对话,并向他们发送赌博网站的链接,以及在X上制造评论。

近两个月前,OpenAI禁止了一组与伊朗Storm-2035秘密行动有关的账户,该行动利用ChatGPT生成内容,这些内容主要关注即将到来的美国总统大选。

Nimmo和Flossman写道:“威胁者对我们模型的使用主要在活动中期——即在他们获得了互联网接入、电子邮件地址和社交媒体帐户等基本工具之后,以及在他们通过一系列分销渠道在互联网上部署社交媒体帖子或恶意软件等‘成品’之前。”

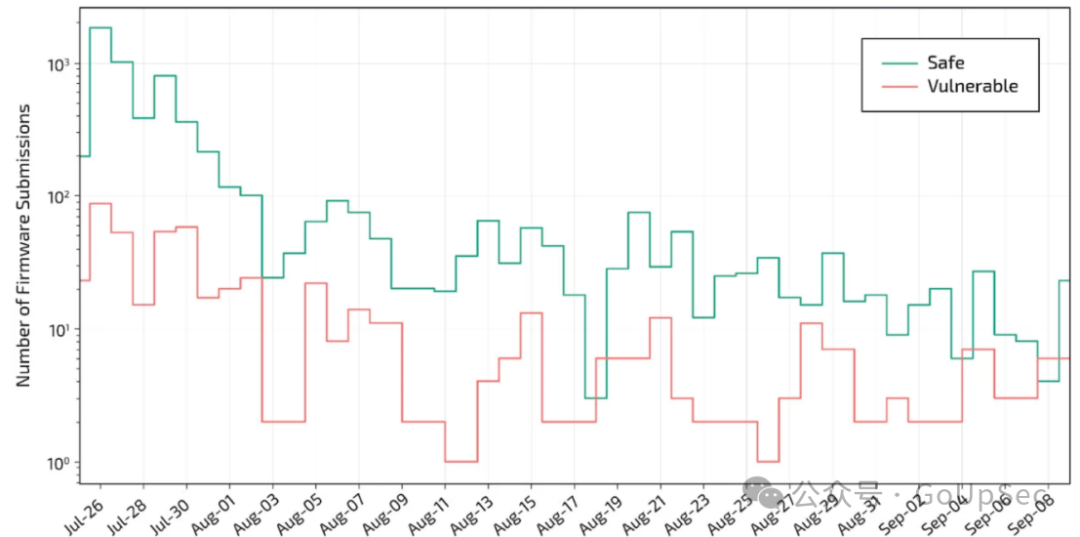

在网络安全公司Sophos上周发布的一份报告中显示:

生成性人工智能可能会被滥用,通过微目标电子邮件传播量身定制的错误信息。

这意味着滥用人工智能模型来编造政治竞选网站、生成政治人物角色,以及根据竞选要点针对性发布电子邮件,从而实现了新的自动化水平,使大规模传播错误信息成为可能。

研究人员Ben Gelman和Adarsh Kyadige表示:“这意味着用户可以通过简易的配置生成任何内容,从良性的竞选材料到错误信息和恶意威胁不等。”

错误信息的影响会使受众与本不支持的候选人结盟,或与他们自认喜欢的候选人意见相左。

消息来源:The Hacker News,译者:XX;

本文由 HackerNews.cc 翻译整理,封面来源于网络;

转载请注明“转自 HackerNews.cc”并附上原文

暂无评论内容