排序

微软警告:朝鲜黑客开始运用 AI 加强网络间谍活动

最新微软报告显示,与朝鲜有关的黑客组织开始应用人工智能技术,提高其网络行动的效率和效果。报告指出,这些黑客正在学习利用基于大语言模型(LLM)的 AI 工具,增强网络攻击活动的成效。

因配置不当,约 5000 个 AI 模型与训练数据集在公网暴露

一名安全研究人员透露,数千个机器学习工具已暴露在开放的互联网中,其中一些还属于大型科技公司。任何人都能访问这些工具,并存在敏感数据泄露的潜在风险。

25位专家联合警告:人工智能安全研究“严重缺乏”

5月21日—22日,第二届人工智能安全峰会正在韩国首尔举行,会议就人工智能的安全性保障、促进创新和包容性未来引领方案等展开讨论。而在此之前,《科学》杂志于5月20日发表了一篇专家论文,呼吁...

英国政府出资 850 万英镑应对人工智能网络威胁

英国承诺投入 850 万英镑资助旨在应对包括深度伪造在内的网络威胁的新型人工智能安全研究。技术部长米歇尔·多尼兰 (Michelle Donelan) 在人工智能首尔峰会上宣布,研究资助将重点关注“系统性...

LangChain 曝关键漏洞,数百万AI应用面临攻击风险

LangChain是一个流行的开源生成式人工智能框架,其官网介绍,有超过一百万名开发者使用LangChain框架来开发大型语言模型(LLM)应用程序。LangChain的合作伙伴包括云计算、人工智能、数据库和其...

个人数据被公开!大量车辆与驾驶数据被用来训练 AI 大模型

Cybernews 网站消息,比荷卢经济联盟(Benelux)最大的汽车经销商 Van Mossel 和多家公司使用了一家不知名的数据分析公司的服务来训练人工智能模型,结果将客户数据泄露到了互联网上。

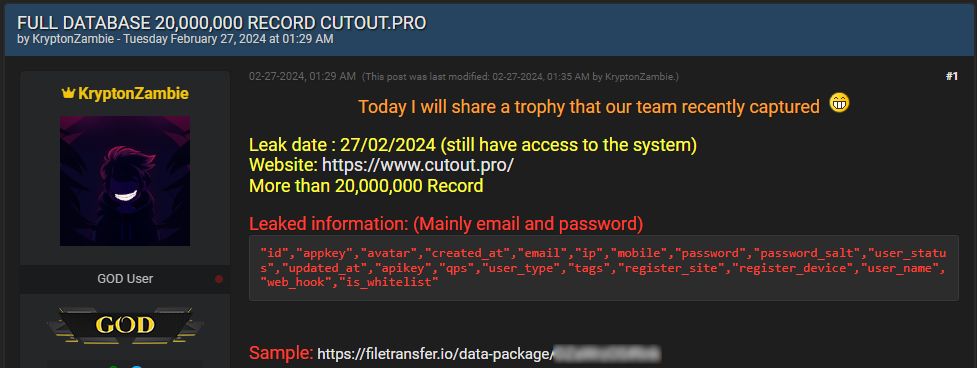

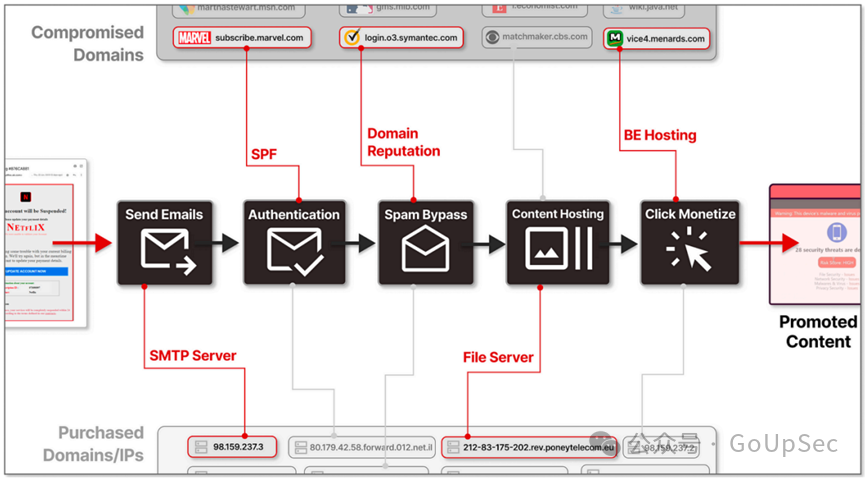

AI加剧网络诈骗:多家知名品牌子域名被劫持发送海量诈骗邮件AI使得

近日,一个名为“SubdoMailing”的大规模广告欺诈活动正在使用8000多个合法互联网域名和1.3万个子域名大量发送垃圾邮件,每天发送量高达500万封电子邮件,用于诈骗和恶意广告盈利。

AI 工具恶意应用榜单出炉,政治内容最热门

谷歌DeepMind部门近日开展了业界首个针对AI技术恶意用途的研究,发现人工智能生成的“深度伪造”在模仿政治人物和名人方面远比用于网络攻击的AI应用更为普遍。

抢占标准制高点,NIST 发布 AI 模型风险测试工具

近日,美国国家标准技术研究院(NIST)重新发布了名为Dioptra的AI模型风险测试平台,用于评估AI风险和恶意攻击,尤其是针对AI模型训练数据的“投毒攻击”。该工具专注于对抗性攻击的测试,提供...

安全114

安全114